キャップに囚われた視野と、誤解されるAIのエネルギー負荷

本物の環境配慮と文明の前進は、技術がもたらすマクロなシステム的効率を取り込むことに依るべきであり、ミクロなコンプライアンスに紐づいた道徳的パフォーマンスや技術恐怖に埋没してはならない。

一、序論:一個のボトルキャップの寓意

2025年、一枚のミーム画像が中国のインターネットで拡散した。

絵は率直だ:一方には算力とモデル反復の競争があり、他方にはプラスチック飲料瓶のキャップを本体にテザーで固定する規定がある――同じ一枚のミームに並べられ、優先順位の話をしているのであって、文明の序列付けではない。

これは風刺漫画家の創作ではなく、現実である。

2024年7月、欧州連合(EU)の「使い捨てプラスチック製品指令」が正式に発効した:全ての使い捨てプラスチック飲料ボトルのキャップは、紐でボトル本体と接続しなければならない。目的はキャップの投げ捨てを減らし、リサイクル率を向上させること。

しかし同年、世界のデータセンターがAIの訓練と稼働で消費した電力は、約400テラワット時――イタリア一国の年間電力消費量にほぼ等しい。そしてこの技術は、医療、科学研究、教育、製造業の根幹を成す論理を再構築しつつある。

これはプラスチック排出の管理が重要ではないと言っているのではない。これは言っているのだ:産業と研究が「使える知性」の基準線を急速に引き上げている一方で、公共の注意は極めて細かく、極めて目に見えるコンプライアンスの細部に長く留まりがちだ――ミクロでは往々にして筋が通っていても、マクロではより大きなレバーを取りこぼす可能性がある。

ミクロの勤勉さが、往々にしてマクロの迷いを覆い隠す。

フランスに留学中の学生がSNSで、このような体験を共有した:

同級の地元の学生は、AIツールの使用を拒んだ。理由は「AIの訓練がエネルギーを消費しすぎて、環境に良くない」から。相手は重大な道徳的選択をしたかのように、真剣な表情をしていた。

しかしこの学生は一度もこの問いを口にしなかった:

この学生本人が、生まれてからこの問題を考えられるようになるまで、どれだけの地球資源を消費したのだろう?

二、エネルギー消費計算の静的な偏り

2.1 誇張されやすい数字

「ChatGPTのエネルギー大食い:GPT-3の訓練消費電力は数千人分の年間電力消費量に相当」――この種の見出しは欧米メディアで頻繁に見られる。

数字自体は間違っていないかもしれない。問題は:これは孤立した数字だ。

いかなる技術進歩にも代償はある。蒸気機関は石炭を燃やし、電力網には銅が必要で、インターネットにはサーバーファームが必要だ。問題は「代償があるか否か」ではなく、「代償と便益が釣り合っているか」である。

AIのエネルギー消費を孤立した枠組みで検討する時、我々は論理的誤りを犯している:顕微鏡でコストを見て、望遠鏡で便益を見る。

2.2 消失する参照系

いかなるコスト計算にも参照系が必要だ。

「AI訓練はエネルギーを消費する」と言う時、問うべきは:代替案は何か?どれだけ消費するのか?

もしAIが人間の労働力を代替するなら、参照系は一人の人間のライフサイクル全体のコストだ。

もしAIが伝統的な工業プロセスを代替するなら、参照系は旧来のプロセスの資源消費だ。

もしAIが科学的研究の発見を加速するなら、参照系は突破口が遅れることによる時間的コストだ。

環境主義者がよく用いる論証方法は:AIのエネルギー消費を単独で取り出し、それが地球資源を「余分に」消費しているかのように装い、既存の消費を「代替」していることを無視する。

これはシステム思考ではない。これは会計的思考――支出だけを記録し、代替を問わない。

三、「無」から「使用可能」へ:一枚の「事前学習」請求書

思考実験をしてみよう。

「AIの訓練はエネルギーを消費しすぎる」と議論する時、暗黙の比較対象は何か?

それは人間の労働力だ。

では、公平な比較枠組みは以下の通りとなるべきだ:

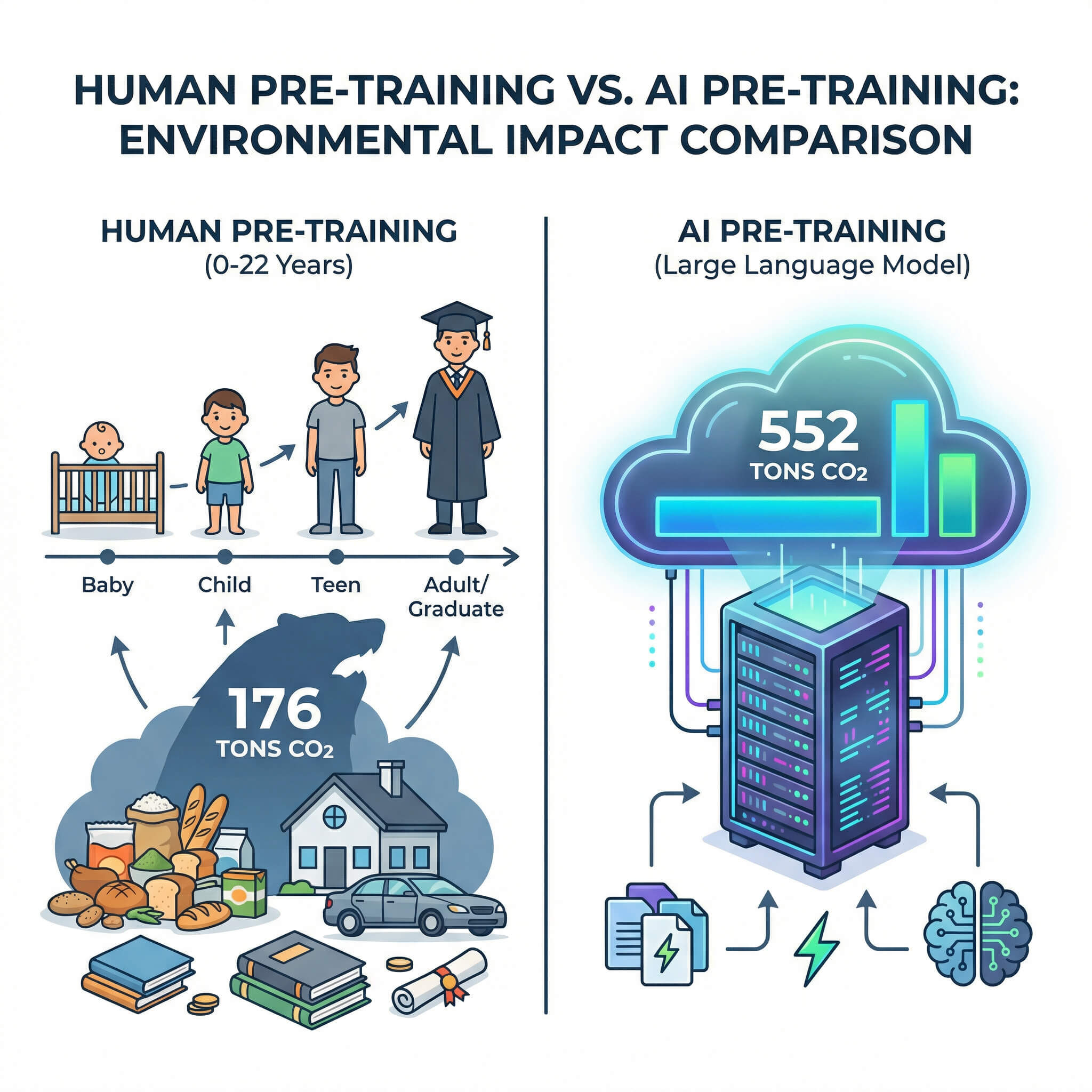

「無」から「仕事能力を有する」まで、それぞれどれだけの資源を消費するか?AIにとって、これは「事前学習コスト」 と呼ばれる。 人間にとって、これは 「成長と教育コスト」 と呼ばれる。

3.1 EU一人当たりデータを参照にした「事前学習」請求書

AI分野では、「事前学習」とはモデルが膨大なデータで学習し、汎用的な言語理解や画像認識能力を獲得することを指す。事前学習が完了して初めて、モデルは「仕事」の基盤を備える。

人間にも同様の段階がある:生まれてから労働市場に入るまで。 以下の記述はあくまで「資源消費の定量化モデル」であることを付記する。生命の意味を労働力だけに還元することはできず、人間の生存と機械を厳密なライフサイクル評価(LCA)だけで一対一に対置することも等価ではない。ただし思想実験として、システム効率をはかるときに私たちが無意識に採っている「二重基準」を浮き彫りにする。我々はあらゆる生命を尊重する。生命が尊いからこそ、反復的で高エネルギー消費、低生産性の労働をAIに代替させ、人間がより創造的な事業に従事できるようにするためには、効率的なAIが必要なのだ。

欧州では、一人の人間は通常以下を必要とする:

- 0-6歳:幼児期、完全な扶養依存

- 6-18歳:義務教育

- 18-22/24歳:高等教育または職業訓練

つまり、欧州の平均的な人間は労働市場に入るための基本的能力を備えるまでに、22-24年の「事前学習」を必要とする。この22年でどれだけの資源を消費するか?炭素排出量:

世界銀行と欧州環境庁(EEA)のデータによると、EU一人当たりの炭素排出量は年間約7-9トン。中央値8トンで計算すると:

この176トンには以下が含まれる:

- 食料生産と輸送:約48トン

- 住居と暖房:約55トン

- 交通移動:約20トン

- 医療、教育、公共サービスの償却費用:約53トン

注意:これはあくまで個人の直接消費の概算である。社会インフラ(道路、病院、学校、公共建築物)の建設・維持コストの分担まで算入すれば、この数字は倍増する可能性がある。水消費量:

- 直接的な水使用:約120万リットル(22年 × 365日 × 150リットル/日)

- 仮想水(食料、衣類などに含まれる間接的水):約1.2億リットル

食料消費量:

- 22年 × 365日 × 約2,500キロカロリー/日

- 合計:約2,000万キロカロリー

3.2 AIモデルの「事前学習」請求書

では、AIの「事前学習」コストを見てみよう。

2021年、Google Researchチームが発表した論文『Carbon Emissions and Large Neural Network Training』は指摘する:

GPT-3の事前学習プロセス全体で、約1,287メガワット時の電力を消費し、約552トンの二酸化炭素相当量を排出した。

552トン vs 176トン。

見かけ上、GPT-3の事前学習コストは人間の3倍だ。

環境主義者はこの数字を繰り返し引用するだろう:「ほら、AIは人間よりも環境に良くない!」

しかしこの結論は、二つの重要な変数を見落としている。

3.3 変数一:サービス規模

22歳の欧州の若者一人が、176トンの炭素を消費して生み出すのは一人分の労働力だけだ。

GPT-3クラスのモデル一つが、552トンの炭素を消費して同時に1億人以上に知識サービスを提供できる。

一人当たりの事前学習コスト:

これは各ユーザーが負担するAI「事前学習コスト」――一匹のミツバチの重量に相当する。

では人間は?

176トン ÷ 1人 = 176,000,000グラム/人。

両者の比率は:

「スキル初期化」段階において、人間の一人当たり炭素コストは、AIの約3,200万倍である。もっとも優れた人間(作家やソフトウェアエンジニアなど)も作品を通じて数百万人に届けうるが、知識のリアルタイムな双方向・大規模同時配信という点では、AIの限界炭素コストはほぼゼロに近い。

3.4 変数二:動作モード

もう一つ見過ごされている差異がある:エネルギースケジューリングの柔軟性だ。

人間は「持続消費型」システムである。

働いていようがいまいが、毎日約2,000キロカロリーを基礎代謝として消費する必要がある。睡眠時、ぼんやりしている時、病気の時、週末の時――エネルギー消費は決して止まらない。

労働市場に入った欧州人が、その後毎年さらに約8トンの二酸化炭素を排出し続ける。40年間働く(22歳から62歳まで)と、さらに320トンを消費することになる。

AIは「オンデマンド消費型」システムである。

クエリ要求がなければ、サーバーは待機、休眠、あるいは停止することもできる。

この差異は以下を意味する:

| 特性 | 人間労働力 | AIシステム |

|---|---|---|

| 初期化コスト | 176トン/人 | 552トン/モデル |

| サービス規模 | 1人 | 1億+ユーザー |

| 一人当たり初期化コスト | 176トン | 5.5グラム |

| 動作モード | 持続消費 | オンデマンド消費 |

| 非稼働時のコスト | 約2トン/年(基礎代謝) | ほぼゼロ |

3.5 結論:同じ勘定枠組みでの比較

我々は「人間の一生」と「AIの一度の訓練」を不公平に比較しているのではない。

我々が言っているのは:

人間であれAIであれ、「無」から「仕事能力を有する」状態になるには、一定の「初期化コスト」を支払う必要がある。

- 人間の初期化コスト:22年、約176トンの炭素、1労働力

- AIの初期化コスト:一度の訓練、約552トンの炭素、1億人以上へのサービス(GPT-3はリリース後極めて短時間で億単位のユーザーに到達)

SNSで「AIは環境に良くない」と断定的に拡散する場合、往々にして「初期化コストおおよそ176トン」量級の生物システムと、「一人当たり訓練コストおおよそ5.5グラム」量級のシリコン系システムを対比している――同一の会計枠組みではない。

これは有効な環境政策論としては不十分で、システム計算を欠いた道徳的ポジショニングに近い。

3.6 「運用」段階の隠れたコスト:代謝とオンデマンド計算

「AIは電気を食う」と言う時、我々は無意識のうちに、その代替品――人間労働力――が「クリーン」であると想定している。しかし物理学上、それは成立しない:人間の生存と協働そのものが、エネルギーと物質の流れを必要とする。

A. 人間の「待機電力消費」:生存すること自体が炭素排出

成人一人が、ただじっとベッドに横たわっているだけ(待機状態)でも、基礎代謝を維持するために毎日約 2,000キロカロリー の食物エネルギーを消費する必要がある。

しかし真の問題は:この2,000キロカロリーはどこから来るのか?

現代農業は、化石燃料に高度に依存したシステムである:

- 化学肥料製造(ハーバー・ボッシュ法):肥料1トン当たり約1.5トンの石炭相当を消費

- 農業機械稼働:ディーゼル

- 食品加工と包装:電力とプラスチック

- コールドチェーン輸送:冷蔵車と冷蔵庫

- 調理:ガスまたは電力

国連食糧農業機関(FAO)のデータによると、世界の食品システムによる炭素排出量は約 1キロカロリー当たり4-7グラムCO2。

これはつまり:

人間という「生体サーバー」の一日の待機コストは、約10キログラムの二酸化炭素である。一方、ChatGPTの一回のクエリによる炭素排出量は約0.2-4.5グラム。モデルが一日数十億件の呼び出しに応答すると、推論(Inference)の積み上げ総エネルギーは依然として大きいが、極度に圧縮された効率エンジンとして、人間一人が一日「待機」するだけで生じる炭素フットプリントでも、AIに2,000回から50,000回 の応答をさせるのに十分だ。もし誰かが「AIは環境に良くない」を理由にツールを拒みながら、生存維持の食物連鎖由来の排出を同じ元帳に載せないなら、その日の食事だけで立ち上がるフットプリントが、モデルが長期にわたって自分に仕事をするコストを上回ることもある――ここで肝心なのは個人攻撃ではなく、口径の一致である。

B. シャットダウン不可能な「生体サーバー」

人間は、シャットダウン不可、ソフトウェアアップデートで消費電力を下げることが不可能な生物システムだ:

- 廃棄物と代謝的な外部性:労働者一人が年間約 500キログラム の生活ゴミを発生させ、数万リットルの浄水を消費し、数トンの汚水を排出する。

- エネルギー変換効率が極めて低い:人間がわずかな脳活動を維持する化学エネルギーを得るために、その背後には膨大な農牧業の産業連鎖がある――それは世界の温室効果ガス排出の最大の発生源の一つである。

- コールドスタートコスト:人間は毎日強制的にシャットダウン(睡眠)しなければならず、しかもシャットダウン状態でもエネルギー消費は30%も低下しない。

C. AI:高い制御性を持つ効率システム

AIシステムの「運用保守」は、人間には全く備わっていない物理的優位性を持つ:

- 弾力性スケール:リクエストがなければ、計算クラスターは深い休眠状態に入るか、冗長な計算能力を他のタスクに割り当てることができる。

- 人間の生体代謝とは異なる:データセンターの冷却には多量の水を用い、GPU製造にはエンボディド・カーボン(Embodied Carbon)も伴うが、AIの稼働そのものは巨大な農産食品チェーンに依存せず、プラスチック包装廃棄物を生み出さず、生活排水も発生しない。

- 地理的デカップリング:AIは極地に設置して自然冷却を利用したり、太陽光発電アレイの隣に設置して100%の廃棄風力・太陽光発電力を使用することができる。一方、人間の労働力は恒温環境に住まなければならず、その生存は化石燃料で支えられた社会基盤に高度に依存している。

結論:もし本当に「究極の低炭素」を追求するなら、非効率な人間の反復労働を大規模にAIで代替することは、しばしばより現実的な排出削減の経路になる。

四、EUを事例に:ミクロの妥当性とマクロのペース

4.1 ボトルキャップの論理

あのボトルキャップに話を戻そう。

EUの規制は、3リットル以下の使い捨てプラスチックボトルについて、キャップはボトル本体と接続しなければならないと定めている。

この規制の意図は良いものだ。ミクロのレベルでは「正しい」。

しかし問題は:一つの文明の知的資源は有限である。

最も優秀な政策立案者、エンジニア、起業家の注意力が、「いかにしてキャップを脱落させないようにするか」といった問題へと導かれる時、彼らには考える余裕がなくなる:いかにしてエネルギーシステムをよりクリーンにするか?工業プロセスをより効率的にするか?AIに気候問題の解決を助けさせるか?

これは「これをしたらあれができない」というゼロサムゲームではない。これは注意力配分の問題、優先順位付けの問題、戦略的視野の問題だ。

統治の物語として時にこう見える:一方で算力と応用は急速に上がり、他方で極めて細かく、感覚に触れやすい分別・リサイクル規則がある。前者が「より道徳的」とは限らず、後者が「誤り」とも限らない――しかし公共議論が後者に長く傾きすぎても、前者の窓はそのせいで遅くなるわけではない。

4.2 GDPR:コンプライアンスコストと市場集中度

2018年、EUは「一般データ保護規則」(GDPR)を導入し、「史上最も厳しいデータ保護法規」と称賛された。

その意図は市民のプライバシーを保護することだ。この目標自体に問題はない。

しかしその副作用は、ほとんど議論されていない:遵守コストは、中小企業にとって極めて重い負担となり、大企業にとっては堀(競争優位)を強化した。

国際プライバシー専門家協会(IAPP)の推計によると、「フォーチュン」誌グローバル500社企業がGDPR遵守のために支出した総コストは78億ドルを超える。

この78億ドルは、Google、Microsoft、Amazonにとっては財務諸表上の一つの数字に過ぎない。しかし欧州発のスタートアップにとって、これは創業初期にほぼ吸収不能な参入障壁となる可能性がある。

- データ収集の遵守コストが極めて高い

- データの越境移動が厳しく制限される

- AI訓練のためのデータ取得が困難になる

結果として:検索、SNS、EC、AIプラットフォームの分野で、欧州に同等規模の域内プラットフォーム企業は相対的に限られる;末端利用者や中小企業が日々依存する多くのサービスは、本社が域外にある大型プラットフォームによって提供される――これは市場構造の記述であり、規制当局の原意を否定するものではない。

EUが巨大企業を抑え、プライバシーの価値を守ろうとする意図は実在する。同時に、遵守コストと集中度の緊張は、多国の経験でも珍しくない。

規制は弱者の束縛であり強者の金庫であってはならない。遵守コストが革新の限界利益を上回る時、そのシステムは低革新均衡に滑り込みやすい。

4.3 AI法:予防的規制のジレンマ

2024年、EUは世界初の包括的なAI規制法規となる「人工知能法」を可決した。

その核心理念は:リスクに基づく段階的規制――AI応用を「容認できないリスク」、「高リスク」、「限定リスク」などのカテゴリーに分類し、それぞれ異なる強さの規制を講じる。

これは理性的に聞こえる。しかし問題は:

技術が急速に反復進化する分野において、「予防的規制」は何を意味するのか?

公的部門がまだある技術の「リスク等級」を評価している間に、産業側はすでに多世代の反復を終えていることが多い。採用、運用、サプライチェーンでのモデル利用は、統一基準より先に着地することもある。規制は必要だが、ペースと粒度が反復速度と長期にずれ続けると、遵守コストはしばしば既存プラットフォームの堀に沈殿し、公衆が安全として体感できる便益に自動的には化けない。

規制は必要だ。しかし規制のタイミングと強さは、技術の果実を雇用と生産性に転化する速度にも影響する。

4.4 プラットフォーム規模と市場構造:比較が示すもの

しばしば出る論点:域外の親会社に頼らず、欧州生まれで時価総額が長く千億ドル級に留まる消費者向けインターネット/プラットフォーム企業を、すぐに三社挙げるのは容易ではない。

- 米国:Apple、Microsoft、Google、Amazon、Meta、Tesla、NVIDIA…

- 中国:Tencent、Alibaba、ByteDance、Meituan、Pinduoduo…

- 欧州:SAP、Spotify、ASML などは各レーンで極めて強いが、上のリストの「プラットフォーム規模」と同じ物差しではない。

欧州には産業ソフト、高端装備、一部のコンテンツ・音楽プラットフォームなど世界級企業がある。消費者向けインターネットと汎用AIプラットフォームの規模比較では、デジタル市場の重心が異なるのは事実で、歴史経路、言語・市場の断片化、資本と人材の流動など多因がある。文明の優劣や単一の道徳判断に還元すべきではない。

規制のデフォルトが「まず停止し、後で議論」に寄るほど、「まず試し、後で規範を収束させる」革新は、時計との競走で試行の余地を得にくい。

文明が長く「過ちを犯さないこと」を「進化すること」の上に置き続けると、内部摩擦とエントロピー増大は自己強化しやすく、是正と追いつきの限界費用はしばしば急上昇する――観察可能な組織ダイナミクスに近く、罵倒ではない。

五、歴史の韻:技術恐怖のいくつかの反響

歴史は繰り返さないが、韻を踏む。

5.1 ラッダイト運動:機械に反対した労働者

19世紀初頭、英国の織物労働者が「ラッダイト運動」を起こした――彼らは機械を破壊し、機械が仕事を奪うと考えた。

彼らの恐怖は現実的だった。彼らの行動は理解できる。

しかし歴史の判決はこうだ:機械は仕事を消滅させず、より多くの仕事、より高い生産性、より普遍的な繁栄を創造した。

機械を破壊した労働者は、当時の生産力の境界では、自覚なく分業深化と生産性の跳躍を客観的に遅らせた可能性がある。歴史が後で強く記憶するのは代償の帰属であり、誰が「より悪いか」ではない。

5.2 原子力をめぐる論争と化石エネルギーへの経路依存

20世紀後半、欧米の環境運動は原子力を高リスク技術と見なした。

- スリーマイル島、チェルノブイリ、福島――それぞれの事故が恐怖を強化した

- 原子力発電所は抗議され、閉鎖され、禁止された

結果は何だったか?

化石燃料はエネルギーシステムを支配し続けた。

一組のデータ:

1960年代、世界の原子力発展は勢いがあった。環境運動の強力な阻止がなければ、2020年までに世界の原子力発電比率は現在の10%から30%以上に上昇していた可能性がある。

これはつまり:年間約40-50億トンの二酸化炭素排出削減を意味する。

一部の環境主義者は「安全」を理由に原子力に反対し、結果として化石燃料の利用期間を延ばし、気候危機をさらに悪化させた。同時に、高算力訓練を「環境に悪い」と曖昧に糾弾する言説もよく見られる――二つの基準が一本の元帳で接続されないと、エネルギー政策と技術ナラティブの断裂が起きやすい。特定文明の「偽善」と決めつけても排出は減らない。勘定を揃え、インセンティブを整えることが肝要だ。

5.3 GMO論争:予防原則が極端に押し出されたとき

欧州のGMO議程にも、同種の緊張が現れた。

「予防原則」が極端に推し進められれば:絶対的な安全が証明できないなら、禁止すべきだ。

しかし問題は:絶対的な安全は存在せず、またいかなる技術の基準ともなり得ない。結果として:欧州は農業バイオテクノロジーの応用に相対的に慎重で、一部品目では農民が従来品種と既存の投入構造により依存しがちになる――食糧安全保障、農薬負荷、研究パイプラインに分解して評価すべきで、「遅れ」一言で蓋をするのは適切ではない。モラルの高みの代償は、往々にして普通の人々が黙って支払う。

六、結語:環境保護は責任であり、必ずしも宗教ではない

序論で出た、AIの使用を拒否した同級生の話に戻ろう(留学生コミュニティの見聞であり、個人が国家を代表しない)。

彼女の選択は善意に基づいている。彼女の懸念は一理ある。

しかし彼女の思考枠組みは、長く見える議題と言説によっても形作られている可能性がある。

この枠組みは彼女に、次のように示唆しがちだ:

- 技術進歩は疑わしい

- エネルギー消費は罪悪である

- 道徳的純潔は効率よりも重要である

- 静的な「行わないこと」は動的な「最適化」よりも高尚である

この枠組みは彼女にこう告げない:

- 一人の人間が生まれてから仕事能力を備えるまでの「初期化コスト」は176トンの炭素であり、AIサービスの一人当たり訓練コストはわずか5.5グラムであること

- AIの「オンデマンド割り当て」エネルギー特性は、人間の持続的基礎代謝と同じ物理制約下にはないこと

- システム最適化は個人の禁欲よりも重要であること

- 真の環境保護はクリーン技術を最も安価な選択肢とすることであって、すべてをより高価にすることではないこと

環境保護は目標でなければならず、教条であってはならない。環境保護は効率を歓迎すべきであって、技術を恐れてはならない。環境保護はシステム思考でなければならず、道徳的パフォーマンスであってはならない。

一つの文明が「キャップが脱落するか否か」で自らの進歩を測り始める時、それはすでに方向を見失っているかもしれない。

一つの文明が「過ちを犯さないこと」を長期的に「進化すること」の上に置き続けると、その発展の勢いは弱まりやすい。

真の環境保護主義者は、以下の問いを立てるべきだ:

いかにしてAIが気候システムをより良く理解するのを助けるか?いかにして技術進歩が全人類の炭素フットプリントを下げるか?いかにして静止の中で純潔を守るのではなく、発展の中で問題を解決するか?

これは「反環境保護」の宣言ではない。これは真の環境主義の在るべき姿である。

一つの文明の成熟は、それがいかに高い道徳的基準を提示できるかではなく、理想と現実、原則と妥協、純潔と効率の間で、持続可能な道を見つけられるかどうかにある。

その道は「AIの使用を拒否する」という道徳的高みを通ることはない。

それは困難な計算、苦痛を伴うトレードオフ、現実的な選択を通るだろう。

しかしその終点は、道徳的には自洽していても、物理と貸借対照表の両面では持続しにくい現在ではなく、真に持続可能な未来である。